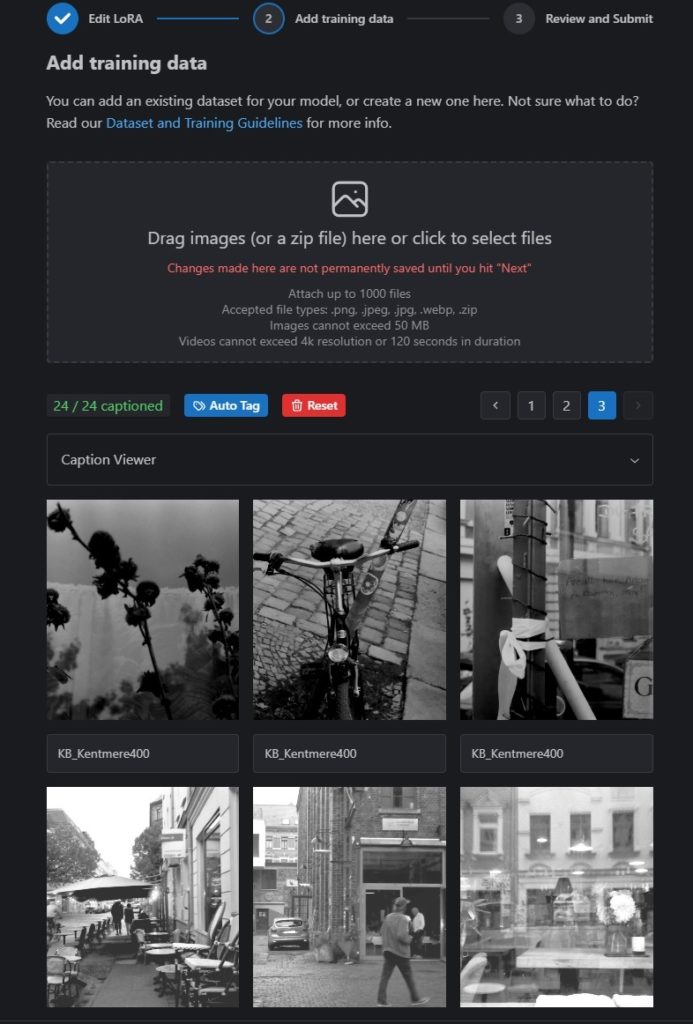

Das Modell basiert auf einigen ausgewählten Analog-Scans vom Typ Mittelformat. Hierbei handelt es sich um einen überlagerten Portra400-Farbfilm.

Wofür ist das Paket interessant?

- Stimmungsbilder (Urlaub, emotionale Szenen)

- Details, Detailbilder mit Fokus auf „Natürlichkeit“

- Produktfotos

- Innenraumgestaltungen (Wohnzimmer, Schlafzimmer, Küche)

- …

Wir haben mit dem Modell 2000 Bilder generiert und es ist eine Gewichtung von 0.8 bis 1.0 in Verbindung mit den bekannten „SDXL“-Datensätzen zu empfehlen.

Interesse an einer Zusammenarbeit? Gerne Kontakt via office@pontipix.de.

Portfolioauszug und Download des Lora unter: https://civitai.com/models/353556/c41hasselbladportra400